Chi lavora in ambito IT o cybersecurity conosce bene la sensazione particolare che arriva alla fine di un audit o dopo una revisione approfondita dell’infrastruttura. Per qualche ora, a volte per qualche giorno, sembra davvero di avere tutto sotto controllo.

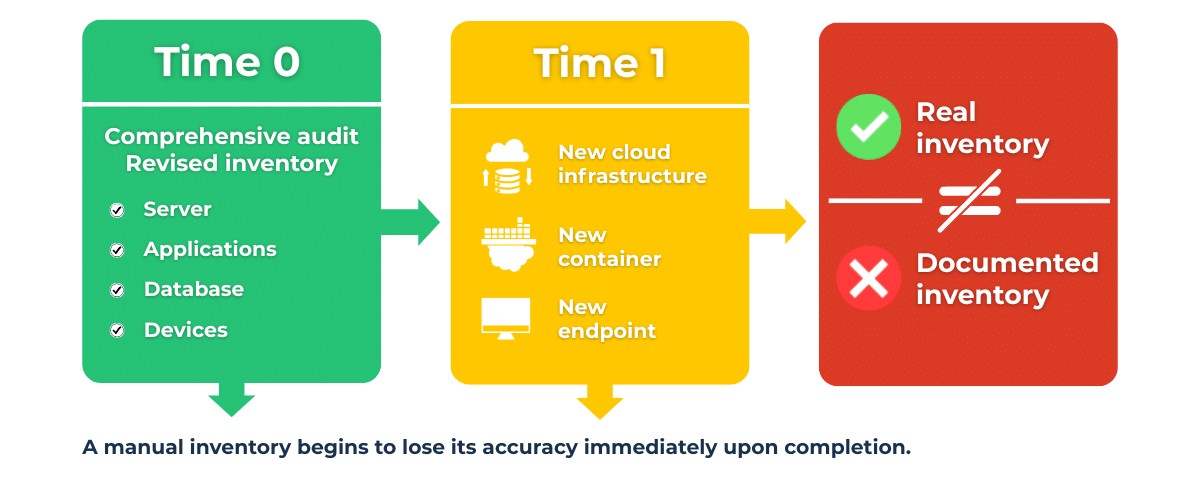

L’inventario degli asset è aggiornato, le applicazioni risultano censite e ogni componente appare correttamente documentato. In quel momento si crea quella che potremmo chiamare una breve illusione di completezza, la percezione di trovarsi nel famoso “punto zero”, ovvero il momento in cui l’infrastruttura appare finalmente mappata in modo completo.

In realtà, nel momento stesso in cui l’inventario viene chiuso una nuova macchina virtuale viene avviata, un servizio cloud viene attivato oppure un container viene creato e distrutto nel giro di pochi minuti. Mentre avvengono queste variazioni, nessuno si preoccuperà di aggiornare l’inventario, rendendo così l’asset inventory appena creato immediatamente obsoleto.

Il risultato è un fenomeno che ricorda da vicino il concetto di entropia, con i dati che tendono a perdere ordine e precisione. Nel caso dell’asset management questo processo è praticamente immediato, dato che le infrastrutture digitali sono ambienti dinamici nei quali componenti e relazioni evolvono in tempo reale.

Se in passato mantenere un inventario aggiornato rappresentava già una sfida, oggi la complessità è aumentata in modo esponenziale.

Il primo elemento riguarda l’espansione del perimetro tecnologico. Un tempo l’infrastruttura aziendale coincideva principalmente con i server presenti nel data center e con i dispositivi dei dipendenti; oggi l’architettura digitale di un’organizzazione include ambienti cloud, container e applicazioni SaaS gestite da terze parti. Questo significa che gran parte dell’infrastruttura può essere creata e distrutta in tempi estremamente brevi.

Un cluster Kubernetes, ad esempio, può generare nuovi container in pochi secondi per gestire un picco di traffico, rimuovendoli subito dopo. Dal punto dell’asset management, ciò introduce una dimensione completamente nuova, dal momento che alcuni componenti dell’infrastruttura esistono solo per pochi minuti.

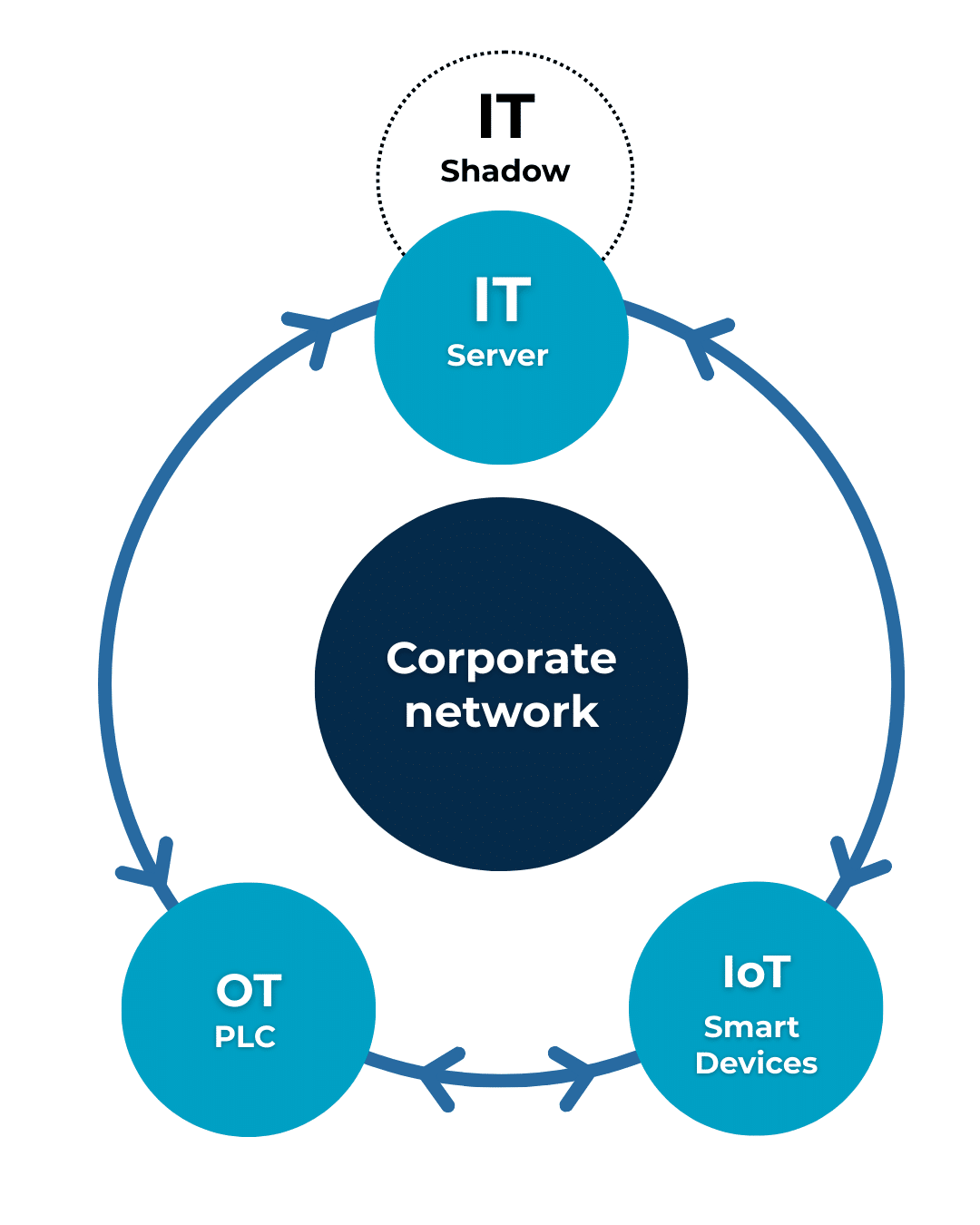

A questa trasformazione si aggiunge un secondo fenomeno molto rilevante, che riguarda la convergenza tra IT e OT. Sempre più spesso i sistemi informativi aziendali dialogano con macchinari industriali e sistemi di controllo, ad esempio i PLC che governano le linee di produzione, mentre i dati di produzione vengono inviati a piattaforme cloud per essere analizzati. Questa integrazione crea una superficie tecnologica molto più ampia rispetto al passato.

In parallelo si è diffusa un’enorme quantità di dispositivi IoT, con sensori ambientali, sistemi di monitoraggio e apparecchiature connesse che introducono centinaia o migliaia di nuovi nodi all’interno della rete. Questi sistemi utilizzano spesso protocolli molto diversi da quelli tradizionali, come Modbus o OPC UA negli ambienti OT, o i protocolli leggeri progettati per dispositivi con risorse limitate che si sono diffusi nel mondo IoT. Di conseguenza gli strumenti di discovery tradizionali, progettati per analizzare traffico TCP/IP standard, riescono a intercettare solo una parte delle comunicazioni che avvengono realmente nella rete.

A tutto questo si aggiunge un fenomeno che molte organizzazioni conoscono bene, ovvero la proliferazione di sistemi che nascono al di fuori dei processi ufficiali di gestione IT. Un team di marketing attiva un servizio SaaS per gestire una campagna, un gruppo di sviluppatori apre un account cloud temporaneo per un progetto, un consulente collega il proprio laptop alla rete aziendale durante un intervento operativo. Tutti questi elementi contribuiscono ad alimentare il famigerato Shadow IT, a cui recentemente si è affiancato lo Shadow AI rispetto al quale le contromisure tecniche oggi disponibili risultano spesso ancora parziali o insufficienti.

Molte organizzazioni continuano a gestire l’inventario degli asset attraverso processi manuali, spesso supportati da fogli di calcolo o da sistemi di documentazione aggiornati periodicamente. Questa scelta comporta un costo operativo significativo, che spesso rimane nascosto all’interno delle attività quotidiane dei team IT, poiché mantenere un inventario manuale richiede un impegno costante da parte delle persone coinvolte e ogni cambiamento dell’infrastruttura dovrebbe essere registrato, verificato e integrato nella documentazione esistente.

Se si prova a tradurre questo lavoro in termini di effort organizzativo, emerge rapidamente quanto sia oneroso e insitamente poco efficiente impiegare ore di lavoro “umane” in attività che potrebbero essere serenamente delegate a sistemi automatici o semi automatici.

Oltre al tema dei costi operativi esiste poi una questione che riguarda la compliance normativa. Molti framework e standard di sicurezza richiedono una visibilità chiara e aggiornata sugli asset presenti nell’infrastruttura, e normative come GDPR, NIS2 o standard come ISO 27001 presuppongono che l’organizzazione sia in grado di dimostrare quali sistemi gestisce e quali controlli di sicurezza sono applicati. Quando i dati sull’infrastruttura non sono aggiornati o risultano incompleti, diventa difficile dimostrare in modo affidabile la conformità ai requisiti richiesti.

Esiste infine una dimensione strettamente legata alla sicurezza. Un asset che non compare nell’inventario tende a rimanere fuori anche da molte altre attività operative come aggiornamenti, monitoraggio e gestione delle vulnerabilità. In queste condizioni un sistema dimenticato può trasformarsi facilmente in un punto di ingresso per un attaccante, semplicemente perché nessuno è consapevole della sua presenza.

Di fronte a questa complessità molte organizzazioni stanno iniziando a rivedere il modo in cui affrontano il problema dell’asset discovery.

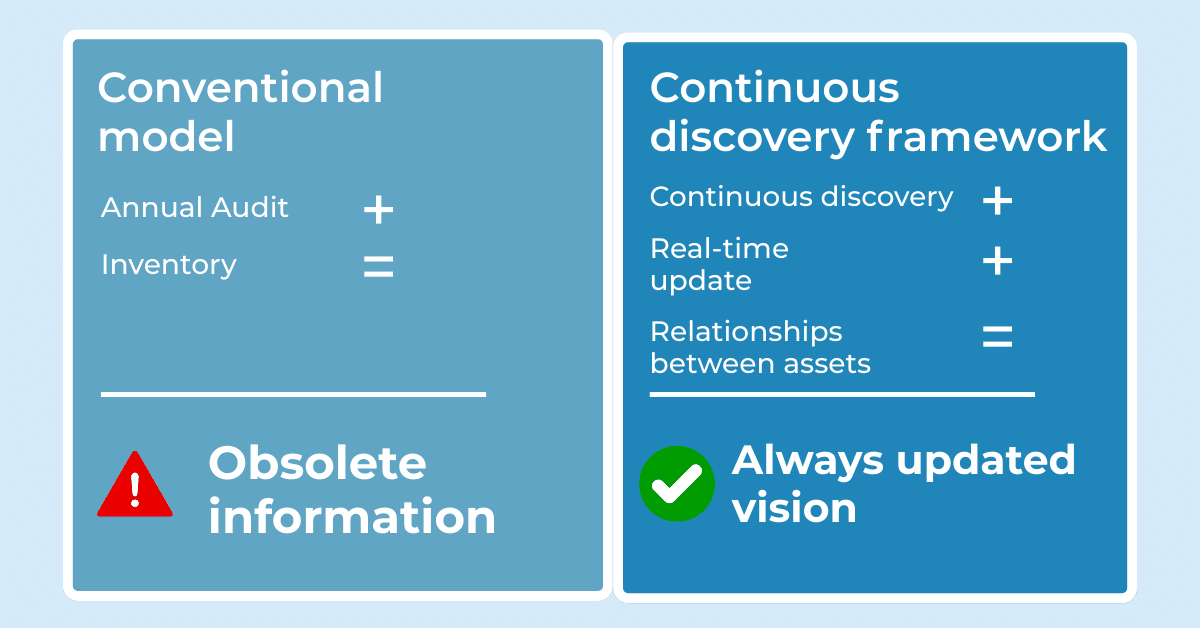

Il cambiamento più importante riguarda il passaggio da una logica di fotografia statica a una logica di osservazione continua. Invece di effettuare controlli periodici sull’infrastruttura, le piattaforme più moderne monitorano costantemente la rete e rilevano automaticamente la comparsa di nuovi sistemi o cambiamenti nelle comunicazioni tra asset. Questo approccio viene spesso definito continuous discovery, dove l’infrastruttura viene osservata come un sistema dinamico nel quale i dati vengono aggiornati in modo progressivo mentre i componenti interagiscono tra loro.

Un ruolo importante è svolto anche dalle integrazioni tra sistemi, attraverso API e connettori dedicati diventa possibile far dialogare tra loro piattaforme diverse come CMDB, soluzioni EDR, MDM e provider cloud, così che ogni sistema contribuisca ad arricchire la visione complessiva dell’infrastruttura.

Quando questi dati vengono aggregati diventa necessario un ulteriore passaggio, quello della riconciliazione delle informazioni. Gli stessi asset possono infatti essere descritti in modi differenti a seconda della fonte da cui provengono i dati, ragion per cui strumenti di orchestrazione e gestione dell’infrastruttura permettono di normalizzare queste informazioni e di costruire una rappresentazione coerente dell’ambiente tecnologico.

In questo scenario gli strumenti tradizionalmente utilizzati per la gestione IT e quelli sviluppati in ambito cybersecurity iniziano a lavorare in modo complementare, contribuendo insieme alla costruzione di una visione più affidabile dell’infrastruttura.

L’idea di un inventario perfetto esercita da sempre un grande fascino su chi gestisce sistemi informativi complessi, poiché la prospettiva di avere una mappa sempre aggiornata dell’infrastruttura è una forma di controllo totale sull’ambiente tecnologico.

L’esperienza operativa dimostra però, come abbiamo visto, che questo obiettivo non è realistico in un contesto caratterizzato da infrastrutture dinamiche, livelli di obsolescenza eterogenei e da una crescente integrazione tra mondi tecnologici differenti. Per questo motivo molte organizzazioni stanno adottando un paradigma diverso, concentrandosi sulla costruzione di sistemi capaci di adattarsi ai cambiamenti dell’infrastruttura e di trasformare l’inventario da documento statico in una rappresentazione viva dell’ambiente tecnologico.

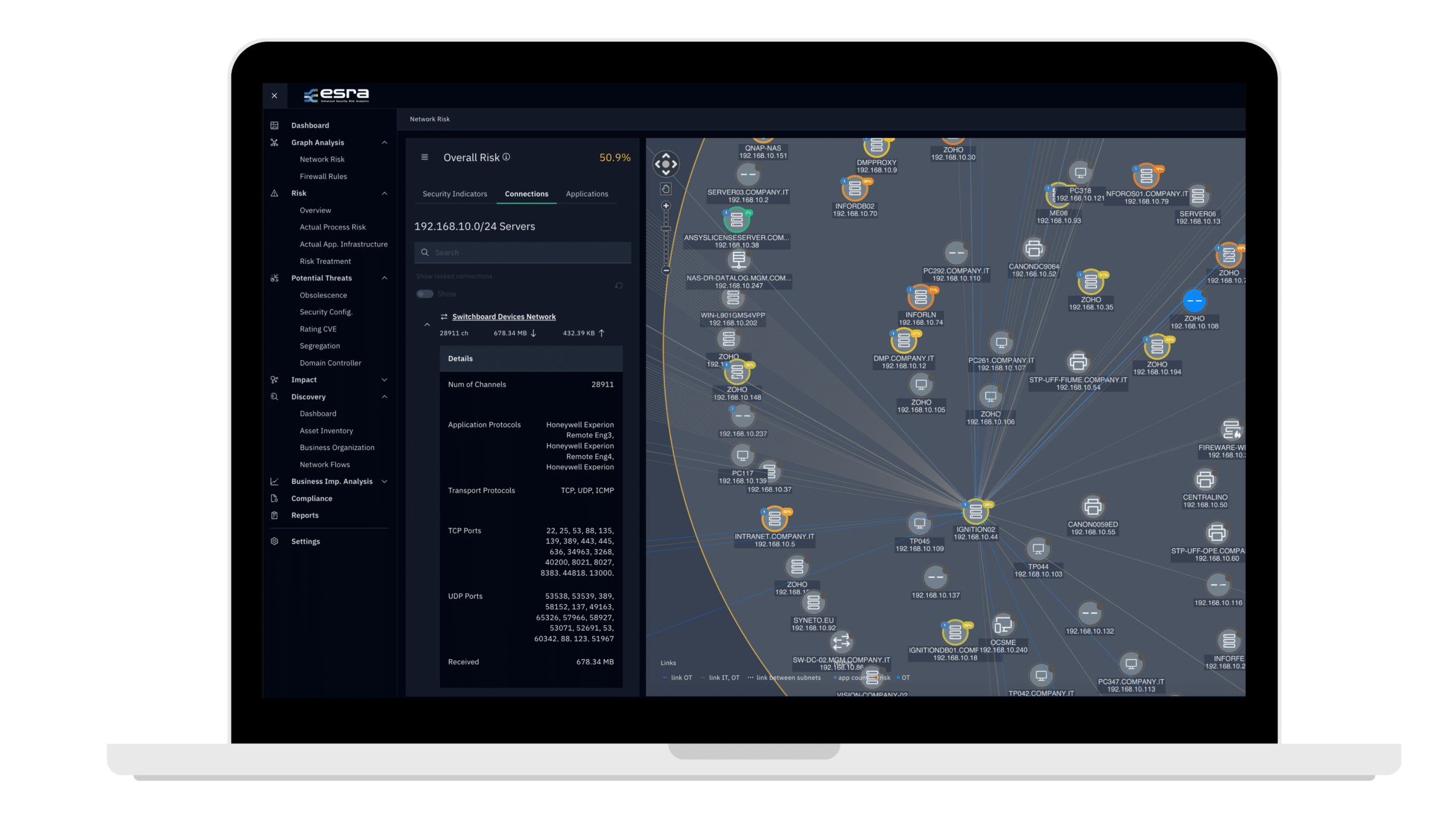

ai.esra porta questo approccio all’interno di un processo più ampio di analisi del rischio, rilevando automaticamente gli asset presenti nel perimetro e ricostruendo le comunicazioni di rete tra i diversi sistemi fino a generare un digital twin dell’infrastruttura che riflette in modo dinamico e continuo lo stato reale dell’ambiente. Questa rappresentazione permette di comprendere come i sistemi interagiscono tra loro e come eventuali minacce possano propagarsi lungo le connessioni esistenti, anche in infrastrutture eterogenee in cui sistemi IT convivono con componenti OT e dispositivi IoT. Osservare l’infrastruttura come un sistema interconnesso e in continua evoluzione è ciò che trasforma l’inventario degli asset da semplice registro tecnico a strumento fondamentale per comprendere la sicurezza dell’intera infrastruttura

La capacità di conoscere e mantenere aggiornato l’asset inventory diventa, oggi, ancora più rilevante grazie alla Direttiva NIS2, che richiede alle organizzazioni una visione chiara dei sistemi che compongono la propria infrastruttura digitale e delle loro interdipendenze. Per supportare le aziende in questo percorso di adeguamento, ai.esra ha sviluppato Nis2do, uno strumento pensato per aiutare le organizzazioni a definire le priorità di intervento e mantenere nel tempo un modello di compliance sostenibile

ai.esra SpA – strada del Lionetto 6 Torino, Italia, 10146

Tel +39 011 234 4611

CAP. SOC. € 50.000,00 i.v. – REA TO1339590 CF e PI 13107650015

“Questo sito si impegna a garantire l’accessibilità digitale secondo la normativa europea (EAA). Per segnalare problemi di accessibilità, scrivi a: ai.esra@ai-esra.com”

ai.esra SpA – strada del Lionetto 6 Torino, Italy, 10146

Tel +39 011 234 4611

CAP. SOC. € 50.000,00 i.v. – REA TO1339590

CF e PI 13107650015

© 2024 Esra – Tutti i diritti riservati